powszechna przypadłość AI jest już dużym kłopotem dla wszystkich tych, którzy korzystają z takich technologii generując min. dane biznesowe, informacje medyczne czy dokumenty sądowe.

Michał Duszczyk

W sieci można znaleźć wiele przykładów oszustw wygenerowanych przez chatboty takich firm jak OpenAI, Google, czy Microsoft. Ten pierwszy (ChatGPT) w marcu wpędził w tarapaty jednego z Amerykańskich prawników, który na rozprawie przytoczył sędziemu federalnemu kilka innych spraw sądowych. Jak się okazało wszystkie precedensy były wyssane z palca, a za fałszywe dane odpowiadał bot, którego prawnik poprosił o wsparcie. AI od Google zasłynęło tym, że pisało bzdury na temat teleskopu Jamesa Webba, zaś algorytmy Microsoftu (Bing) kłamały o piosenkarce Billie Eilish.

Halucynacje AI większe niż sądzono

Jak się okazuje, tzw. halucynacje to dość częsta przypadłość chatbotów. „New York Times” wskazuje, iż systemy tego typy wymyślają w przypadku nawet co czwartej odpowiedzi. Dziennik opisuje badanie firmy Vectara, która pochyliła się nad częstotliwością takich fałszerstw – z jej badań wynika, iż technologie poszczególnych firm mają różne predyspozycje do kłamania. Generalnie boty wprowadzają użytkowników w błąd w od 3 do 27 proc. przypadków.

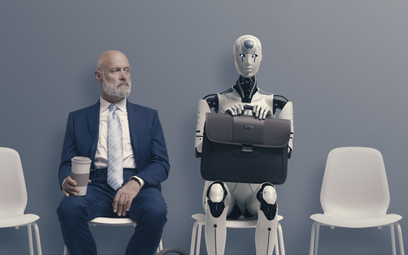

O ile dla przeciętnego użytkownika konwersacyjnej sztucznej inteligencji takie zdarzenie może być frustrujące, to nie stwarza jednak poważniejszych komplikacji. Ale powszechna przypadłość AI jest już dużym kłopotem dla wszystkich tych, którzy korzystają z takich technologii generując min. dane biznesowe, informacje medyczne, czy wspomniane dokumenty sądowe.

Kto bardziej zmyśla? ChatGPT Claude czy Bard?

Eksperci z Vectary zbadali, które z botów „halucynują” najczęściej. Jak wynika z analiz, najmniejszy udział fałszywych odpowiedzi miał system stworzony przez OpenAI – w tym wypadku wskaźnik sięgnął 3 proc. Gorzej wypadł system AI od koncernu Meta (5 proc.), czy, jak zauważa Simon Hughes, badacz z Vectary, startupu Anthropic (jego model Claude 2 zmyślał w ponad 8 proc. przypadków). Prawdziwym „królem” oszustw okazał się jednak PaLM, a więc model opracowany przez Google – tu współczynnik ten dobił do aż 27 proc.