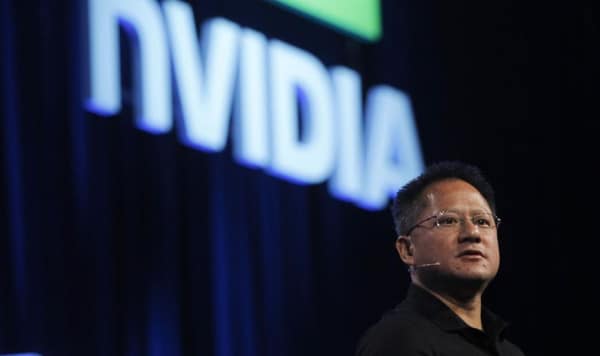

W dziedzinie technologii niezwykle rzadko padają deklaracje o tak znaczącej wadze. Podczas występu w znanym podcaście Lexa Fridmana, Jensen Huang, dyrektor generalny Nvidii, wygłosił słowa, które natychmiast rozeszły się szerokim echem w branży: „Uważam, że to właśnie teraz. Uważam, że osiągnęliśmy AGI”. Ta śmiała teza o stworzeniu modelu sztucznej inteligencji, który dorównuje ludzkiej inteligencji, wymaga jednak szerszego ujęcia i uwzględnienia zastrzeżeń samego autora.

W powszechnym rozumieniu AGI (Artificial General Intelligence), czyli ogólna (lub silna) sztuczna inteligencja, to system posiadający zdolność równania się z ludzką inteligencją lub jej przewyższania w niemal każdym kognitywnym zadaniu. To termin, który wywołuje spory, od którego wielu liderów technologicznych usiłuje się ostatnio zdystansować, postrzegając go jako zbyt niejasny lub nadmiernie eksploatowany przez media.

Niemniej jednak, temat ten notorycznie powraca na pierwsze strony gazet, zwłaszcza gdy wypowiada się na jego temat ktoś taki jak Jensen Huang, współtwórca i prezes firmy Nvidia. Podczas rozmowy z Lexem Fridmanem, która została opublikowana 23 marca 2026 roku, kontekst AGI był bardzo precyzyjny. Prowadzący zdefiniował AGI jako system, który jest w stanie "wykonywać twoją pracę" – na przykład zakładać, rozwijać i prowadzić firmę technologiczną o wartości przekraczającej bilion dolarów.

Zastrzeżenia prezesa Nvidii

Następnie zapytał Huanga, kiedy jego zdaniem AGI stanie się rzeczywistością — pytając, czy to kwestia, powiedzmy, 5, 10, 15 czy 20 lat. Huang odparł: Uważam, że to już. Uważam, że osiągnęliśmy AGI. Jednocześnie jednak dołożył kontekst: Wielu ludzi używa tego przez kilka miesięcy, a potem to zanika. Prawdopodobieństwo, że 100 000 takich agentów zbuduje coś porównywalnego do Nvidii, wynosi zero procent.

It was an honor to hang out with Jensen Huang, CEO of @nvidia, and do a long-form podcast with him. Really fun & fascinating technical deep-dive conversation on & off the mic. One of the most brilliant & thoughtful human beings I've ever met. NVIDIA is the most valuable company… pic.twitter.com/s2rOUYmPMg

— Lex Fridman (@lexfridman) March 22, 2026

Zatem zwrócił uwagę na dwa zasadnicze ograniczenia. Po pierwsze, to ulotność sukcesów, gdzie spora część obecnych projektów, które bazują na agentach AI, jest używana zaledwie przez kilka miesięcy. Brakuje im ciągłości i zdolności do podtrzymania sukcesu w dłuższej perspektywie. Po drugie, zastrzegł deficyt złożoności systemowej. Huang stanowczo oznajmił, że aktualna AI nie ma możliwości stworzenia firmy o skali i zawiłości Nvidii.

Autorskie modele Nvidii

Oświadczenie Huanga nie pojawiło się w oderwaniu od faktów. Nvidia, która jest kojarzona głównie z wytwarzaniem chipów, aktywnie rozwija swoje własne, otwarte modele AI, stanowiące podstawę pod „epokę agentów”. Do nich przynależą zwłaszcza modele open-source z rodziny Nemotron, które są skupione na zadaniach związanych z agentami i rozumowaniem, a także multimodalny NVLM.

Nemotron to gama modeli, które zostały zoptymalizowane pod kątem działań agentów, rozumowania, wizji i mowy. Warianty takie jak Nano, Super czy Ultra są precyzyjnie dostosowane do osiągnięcia maksymalnej produktywności na urządzeniach Nvidii.

Zaś NVLM (Nvidia Vision Language Model) to multimodalne modele (na przykład NVLM 1.0 72B), które w obszarze zadań wizyjno-językowych, takich jak OCR (z ang. Optical Character Recognition, czyli optyczne rozpoznawanie znaków) czy rozumowanie wizualne, skutecznie rywalizują z GPT-4o.

Modele Nvidii zajmują specyficzną lukę na rynku, który jest zdominowany przez gigantów takich jak OpenAI, Google czy Anthropic. W rankingach takich jak Artificial Analysis, modele Nvidii (na przykład Nemotron 3 Super) wyróżniają się rekordową szybkością generowania tokenów (podstawowych jednostek tekstu, jak słowa lub ich części) model wytwarza na sekundę podczas odpowiedzi i bardzo niskimi kosztami użytkowania w porównaniu do zamkniętych modeli GPT-5 czy Claude 4.

Mimo że Nvidia dominuje w efektywności na GPU, topowe modele zamknięte (GPT-5, Claude 4, Gemini 3 Pro) wciąż prowadzą w najbardziej wymagających benchmarkach, które dotyczą ogólnego rozumowania. Modele te są rzadziej spotykane w popularnych rankingach typu LMSYSChatbot Arena, ponieważ Nvidia koncentruje się na rozwiązaniach open-sourced dla deweloperów i optymalizacji sprzętowej, a nie na tworzeniu konsumenckich chatbotów.