Chiński deweloper Kuaishou zaprezentował trzecią wersję modelu generowania wideo Kling AI.

🚀 Przedstawiamy model Kling 3.0: Każdy może być reżyserem. Czas.

Kompleksowy silnik kreatywny, który umożliwia w pełni natywne tworzenie multimodalne.

— Doskonała spójność: Twoje postacie i elementy są zawsze spójne.

— Elastyczna produkcja wideo: Twórz 15-sekundowe klipy z precyzją… pic.twitter.com/CJBILOdMZs— Kling AI (@Kling_ai) 4 lutego 2026

„Kling 3.0 opiera się na głęboko zunifikowanej platformie edukacyjnej, zapewniającej prawdziwie natywne, multimodalne wejście i wyjście. Dzięki płynnej integracji audio i zaawansowanej kontroli spójności elementów, model ten nadaje generowanej części większą dynamikę i integralność” – czytamy w ogłoszeniu.

Model ten łączy w sobie kilka zadań: konwersję tekstu, obrazów i odniesień do filmów, dodawanie lub usuwanie treści oraz modyfikowanie i przekształcanie filmów.

Długość przerywników filmowych została wydłużona do 15 sekund. Inne ulepszenia obejmują bardziej elastyczne zarządzanie klatkami i dokładniejsze podpowiedzi. Zwiększono ogólny realizm: ruchy postaci stały się bardziej wyraziste i dynamiczne.

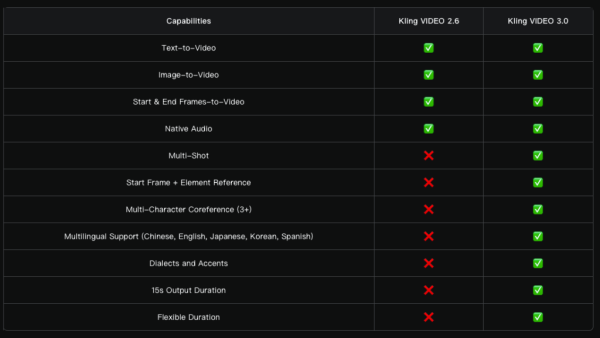

Porównanie Kling VIDEO 3.0 z Kling VIDEO 2.6. Źródło: Kling AI.

Nowa funkcja Multi-Shot analizuje monit, aby określić strukturę sceny i typy ujęć, a następnie automatycznie dostosowuje kąty kamery i kompozycję.

Model ten wspiera różnorodne rozwiązania montażowe: od klasycznych dialogów w schemacie „ujęcie-kontrujęcie” po narrację równoległą i sceny z narracją lektorską.

„Nie ma już potrzeby żmudnego cięcia i edycji filmów — jedno pokolenie wystarczy, aby stworzyć filmowy klip i udostępnić złożone formy audiowizualne wszystkim twórcom” — czytamy w ogłoszeniu.

Kling 3.0 to naprawdę „wielki krok w generowaniu filmów AI”! Zobaczcie ten niesamowity mockument od Simona Meyera, kreatywnego partnera Kling AI! pic.twitter.com/Iyw919s6OJ

— Kling AI (@Kling_ai) 5 lutego 2026

Oprócz standardowego generowania wideo na podstawie obrazu, Kling 3.0 obsługuje wiele obrazów jako odniesień, a także źródła wideo jako elementy sceny.

Model oddaje charakterystykę postaci, obiektów i sceny. Niezależnie od ruchu kamery i rozwoju fabuły, kluczowe obiekty pozostają stabilne i spójne w całym materiale wideo.

Twórcy gry udoskonalili natywną ścieżkę dźwiękową: system dokładniej synchronizuje mowę z mimiką twarzy, a w scenach z dialogami umożliwia ręczne wskazanie konkretnego mówcy.

Lista obsługiwanych języków została rozszerzona o chiński, angielski, japoński, koreański i hiszpański. Ulepszono również rozpoznawanie dialektów i akcentów.

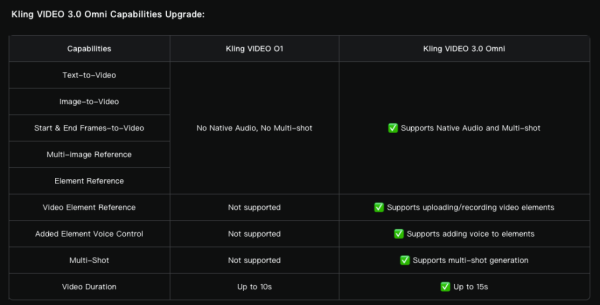

Dodatkowo zespół dokonał modernizacji multimodalnego modelu O1 do wersji Video 3.0 Omni.

Źródło: Kling AI.

Można przesłać nagranie audio z wypowiedzią trwającą trzy sekundy lub dłużej i wyróżnić głos lub nagrać wideo z wypowiedzią postaci trwającą od trzech do ośmiu sekund, aby uchwycić jej główne cechy.

Konkurenci Sory nadchodzą

Firma OpenAI zaprezentowała model generowania wideo Sora w lutym 2024 roku. Narzędzie wywołało poruszenie w mediach społecznościowych, ale jego publiczna premiera miała miejsce dopiero w grudniu.

Prawie rok później użytkownicy uzyskali dostęp do funkcji generowania filmów na podstawie opisów tekstowych, „animowania” obrazów i dodawania ich do gotowych filmów.

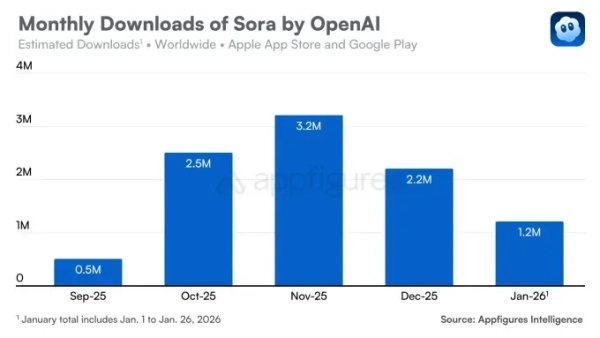

Aplikacja Sora na iOS została wydana we wrześniu i natychmiast przykuła uwagę użytkowników: pierwszego dnia została zainstalowana ponad 100 000 razy. Usługa przekroczyła granicę miliona pobrań szybciej niż ChatGPT, pomimo dostępu na zaproszenie.

Jednak trend ten szybko się odwrócił. W grudniu liczba pobrań spadła o 32% w porównaniu z poprzednim miesiącem. W styczniu tendencja spadkowa się utrzymała – aplikacja została pobrana 1,2 miliona razy.

Źródło: Appfigures.

Spadek wynika z kilku czynników. Po pierwsze, zaostrzyła się konkurencja ze strony modelu Nano Banana firmy Google, który wzmocnił pozycję Gemini.

Sora konkuruje również z Meta AI i jej funkcją Vibes. W grudniu presję na rynku zwiększył startup Runway, którego model Gen 4.5 przewyższył swoich konkurentów w niezależnych testach.

Po drugie, produkt OpenAI napotkał problem naruszenia praw autorskich. Użytkownicy tworzyli filmy z popularnymi postaciami, takimi jak SpongeBob Kanciastoporty i Pikachu, co zmusiło firmę do zaostrzenia ograniczeń.

Sytuacja ustabilizowała się w grudniu po podpisaniu umowy z Disneyem, która umożliwiła użytkownikom generowanie filmów z postaciami studia. Nie przełożyło się to jednak na wzrost liczby pobrań.

Przypomnijmy, że w październiku w serwisie Sora pojawiło się mnóstwo deepfake'ów z udziałem Sama Altmana.