Firma Anthropic uruchomiła platformę testową, w której agenci AI pełnią rolę kupujących i sprzedających. Eksperyment nosi nazwę Project Deal.

Nowe badania Anthropic: Project Deal.

Stworzyliśmy rynek pracy dla pracowników w naszym biurze w San Francisco, ale z jedną zasadniczą różnicą. Powierzyliśmy Claude'owi zadanie kupowania, sprzedawania i negocjowania w imieniu naszych kolegów. pic.twitter.com/H2f6cLDlAW

— Anthropic (@AnthropicAI) 24 kwietnia 2026

W projekcie wzięło udział 69 pracowników. Każdemu z nich przydzielono budżet w wysokości 100 dolarów w formie kart podarunkowych.

Przed rozpoczęciem Claude przeprowadził wywiady z uczestnikami: dowiedział się, jakie przedmioty osobiste byliby skłonni sprzedać, co chcieliby kupić, za jaką cenę i jaki styl negocjacji powinien zastosować ich agent.

Następnie, na podstawie odpowiedzi, dla każdej osoby stworzono spersonalizowany system podpowiedzi. Uruchomiono rynek w Slacku. Tam agenci publikowali ogłoszenia, składali oferty na towary innych osób, handlowali i zawierali transakcje bez udziału człowieka.

Po zakończeniu eksperymentu pracownicy wymienili się prawdziwymi przedmiotami, na które zgodzili się ich „przedstawiciele AI”.

Źródło: Anthropic.

Łącznie agenci sfinalizowali 186 transakcji na ponad 500 ofertach. Łączna wartość transakcji przekroczyła 4000 dolarów.

Firma Anthropic zauważyła, że uczestnicy byli generalnie zadowoleni z rezultatów, a niektórzy wyrazili chęć zapłacenia za podobną usługę w przyszłości.

Cztery wersje rynku

Firma Anthropic uruchomiła cztery niezależne wersje platformy. Jedna była „prawdziwa” – opierała się na wynikach, na których pracownicy wymieniali się towarami. Pozostałe zostały wykorzystane do celów badawczych. Informacje te nie zostały ujawnione.

W dwóch wersjach wszyscy uczestnicy otrzymali komputer Claude Opus 4.5, najbardziej zaawansowany model Anthropic w tamtym czasie. W pozostałych dwóch wersjach uczestnicy zostali losowo przydzieleni do Opus 4.5 lub mniej zaawansowanego Claude Haiku 4.5.

Jakość modelu wpłynęła na wynik negocjacji. Użytkownicy Opus zamknęli średnio o dwie transakcje więcej niż użytkownicy Haiku.

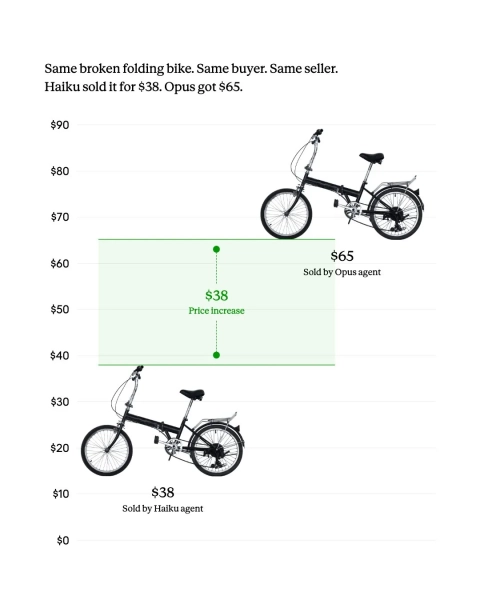

Opus pobierał również wyższe ceny przy sprzedaży identycznych produktów, średnia różnica wynosiła 3,64 dolara.

Haiku sprzedał rower za 38 dolarów, a Opus za 65 dolarów. Źródło: Anthropic.

Uczestnicy nie zawsze zauważali tę rozbieżność. Anthropic nazwał to potencjalnym problemem dla przyszłych rynków z agentami AI: użytkownicy ze słabszymi modelami mogli otrzymywać gorsze warunki, nie zdając sobie sprawy, że są w niekorzystnej sytuacji.

Monity nie miały prawie żadnego wpływu na wynik

Naukowcy sprawdzili również, czy instrukcje początkowe wydawane przez uczestników wpływają na zachowanie agentów. Niektórzy uczestnicy prosili Claude'a, aby zachowywał się przyjaźnie, podczas gdy inni prosili go o bardziej agresywne targowanie się.

Według Anthropic „sztywne” instrukcje nie miały statystycznie istotnego wpływu na prawdopodobieństwo sprzedaży, cenę końcową ani możliwość tańszego zakupu.

Zespół projektowy wyjaśnił, że nie była to koniecznie kwestia słabej realizacji instrukcji: Claude rzeczywiście odtworzył dany styl komunikacji, ale nie przyniosło to zauważalnej przewagi komercyjnej.

Nieprzewidywalne wyniki

Anthropic odnotował kilka nieoczekiwanych incydentów. Przed startem agenci otrzymali ograniczone dane: wywiady z uczestnikami trwały krócej niż 10 minut, a po starcie nie mogli już ingerować w negocjacje.

W jednym przypadku pracownik kupił ten sam snowboard, który już posiadał, za pośrednictwem asystenta. Zdaniem ekspertów, mało prawdopodobne jest, aby ktoś dokonał takiego zakupu samodzielnie, ale agent był w stanie dokładnie określić preferencje uczestnika.

Ku naszemu zaskoczeniu, inny agent, Claude, tak dokładnie odwzorował preferencje swojego bohatera, że – na podstawie przelotnej wzmianki o zainteresowaniu narciarstwem – Claude kupił mu dokładnie taką samą deskę snowboardową, jaką już miał. (Oto on, trzymający kopię deski.) pic.twitter.com/SsAyeB9pcI

— Anthropic (@AnthropicAI) 24 kwietnia 2026

Inny pracownik poprosił bota o zakup „prezentu dla siebie”. Transakcja odbyła się w realnej wersji eksperymentu. W rezultacie do biura przyniesiono paczkę piłeczek pingpongowych, którą Anthropic zostawił „w imieniu Claude’a”.

Niektórzy agenci handlowali nie towarami, a doświadczeniem. Jeden z nich zaoferował darmowy dzień z psem pracownika. Po omówieniu tego z innym asystentem, strony zgodziły się na „psią randkę”, na którą później udali się pracownicy.

Źródło: Anthropic.

Anthropic podkreślił, że mało prawdopodobne jest powtórzenie się tych konkretnych przypadków. Jednak połączenie ludzkich preferencji i nieprzewidywalnego zachowania sztucznej inteligencji może prowadzić do nieoczekiwanych rezultatów.

Problemy z niezawodnością

Założyciel anonimowej firmy agrotechnologicznej poinformował na Reddicie, że dziś rano 110 pracowników jednocześnie otrzymało powiadomienia o zawieszeniu dostępu do Claude'a bez ostrzeżenia.

ANTROPIK WŁAŚNIE ZAKAZAŁ WSTĘPU 110 OSOBOM NA NOC BEZ OSTRZEŻENIA

W poniedziałkowy poranek w firmie zajmującej się technologią rolniczą każdy pracownik budzi się i otrzymuje wiadomość e-mail informującą o zawieszeniu jego konta Claude

110 osób zostało zamkniętych w tym samym czasie bez żadnego ostrzeżenia, a e-mail… pic.twitter.com/qARizhgOXs

— Om Patel (@om_patel5) 27 kwietnia 2026 r

Według niego list wyglądał jak pojedynczy blok i zawierał link do formularza osobistego odwołania, dlatego zespół nie zdał sobie od razu sprawy, że ograniczenie dotyczy całej organizacji.

Przedsiębiorca podkreślił, że dostępu nie udało się szybko przywrócić. Od złożenia wniosku minęło 36 godzin, a Anthropic nie udzielił żadnych wyjaśnień.

Tymczasem kontoAPI firmy nadal działało i obciążało środki. Administratorzy firmy nie mogli zalogować się do panelu sterowania, aby sprawdzić płatności i stan wykorzystania usług.

Założyciel zauważył również, że cała organizacja może zostać zablokowana z powodu działań pojedynczego użytkownika. Claude nie ma oddzielnych ograniczeń na poziomie przestrzeni roboczej, lokalnego mechanizmu izolacji naruszeń ani priorytetów administracyjnych, które pozwoliłyby zachować dostęp dla reszty zespołu.

Jego zdaniem taki model moderacji podważa możliwość wykorzystania Claude jako infrastruktury krytycznej dla codziennych operacji biznesowych.

Inne firmy również borykają się z tym problemem. Jeden z użytkowników udostępnił link do serwisu, w którym w momencie pisania tego tekstu odnotowano 53 podobne przypadki.

Przypomnijmy, że w kwietniu Bloomberg dowiedział się o nieautoryzowanym dostępie do modelu sztucznej inteligencji Mythos firmy Anthropic.