Anthropic wprowadza na rynek Claude Opus 4.7, najmocniejszy jak dotąd model w serii Opus.

Poznaj Claude Opus 4.7 — nasz jak dotąd najbardziej zaawansowany model Opus.

Jest ostrożniejsza, jeśli chodzi o zadania długoterminowe, dokładniej postępuje zgodnie z instrukcjami i sprawdza swoje odpowiedzi przed ich wysłaniem.

Możesz jej powierzyć najtrudniejsze zadania, ale z mniejszym nadzorem. pic.twitter.com/PtlRdpQcG5

— Claude (@claudeai) 16 kwietnia 2026

Nowa wersja jest dostępna dla wszystkich płacących użytkowników Claude i użytkownikówAPI — 5 USD za 1 milion tokenów przychodzących, 25 USD za 1 milion tokenów wychodzących.

Kluczowe ulepszenia

Opus 4.7 najlepiej sprawdza się w złożonych zadaniach. Użytkownicy powierzają mu zadania, które wcześniej wymagały ścisłego monitorowania, zauważyli twórcy.

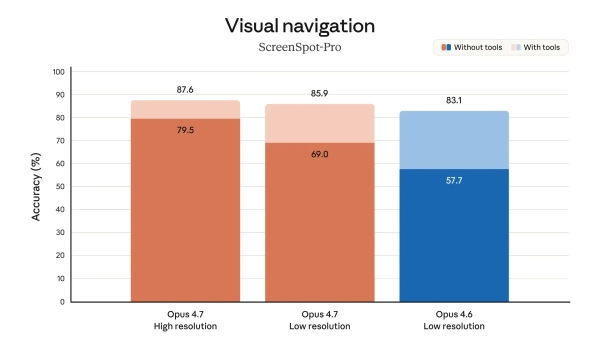

W programowaniu agentów model przewyższył swojego poprzednika o 10%, a w przetwarzaniu danych wizualnych o 13%. W innych wskaźnikach wzrost jest bardziej umiarkowany.

Model ten charakteryzuje się znacznie rozszerzonymi możliwościami wizualnymi: przetwarza obrazy o rozdzielczości aż 2576 pikseli na dłuższym boku (ok. 3,75 MP) — ponad trzykrotnie większej niż poprzednie wersje Claude'a.

Źródło: Anthropic.

Opus 4.7 ściślej przestrzega instrukcji. Polecenia napisane dla starszych modeli mogą dawać nieoczekiwane rezultaty: luźno interpretowały instrukcje, podczas gdy nowa wersja traktuje je dosłownie. Zaleca się ponowną konfigurację zapytań.

Ponadto Claude nauczyła się ostatnio zapamiętywać informacje pomiędzy sesjami — zapisuje notatki w plikach i może z nich korzystać podczas każdej nowej rozmowy.

Anthropic dodał nowy poziom wysiłku w Opus 4.7, xhigh („ekstra wysoki”), pomiędzy poziomami high i max. Pozwala on precyzyjnie dobrać równowagę między głębokością analizy a szybkością reakcji.

W Claude Code domyślny poziom wysiłku został zwiększony do xhigh dla wszystkich planów.

Inne innowacje:

- Budżety zadań (interfejs API w wersji beta publicznej) — zarządzanie wydatkami na tokeny;

- /ultrareview — dedykowana sesja przeglądu kodu w Claude Code;

- tryb automatyczny dla użytkowników Max — Claude podejmuje decyzje samodzielnie.

Ograniczenia możliwości cybernetycznych

Opus 4.7 jest słabszy niż Mythos Preview pod względem cyberbezpieczeństwa. Anthropic celowo ograniczył te możliwości podczas szkolenia. Model posiada wbudowaną ochronę, która blokuje żądania zabronione i wysokiego ryzyka.

„To, czego nauczymy się, wdrażając te mechanizmy ochronne w praktyce, pomoże nam w dążeniu do naszego ostatecznego celu, jakim jest szerokie udostępnienie modeli klasy Mythos” – zauważył zespół startupu.

Zapraszamy profesjonalistów z branży bezpieczeństwa, którzy chcą używać Opus 4.7 w uzasadnionych celach (badania podatności, testy penetracyjne) do dołączenia do nowego programu Cyber Verification w Anthropic.

Dla użytkowników ograniczenia te stały się problemem. Niektórzy klienci narzekają, że model odmawia pisania kodu, ponieważ „widzi złośliwe oprogramowanie w każdym żądaniu”.

Podejrzewa, że wszystko jest złośliwym oprogramowaniem i nadal odmawia napisania kodu po potwierdzeniu, że nie ma żadnego złośliwego oprogramowania pic.twitter.com/YXpaoNV8YG

— Hanh Nguyen (@fashiongiik) 16 kwietnia 2026 r

Odpowiedź OpenAI

OpenAI wprowadziło „dużą aktualizację” do Kodeksu, który jest obecnie dostępny tylko na macOS.

Kodeks (prawie) wszystkiego.

Teraz może korzystać z aplikacji na Twoim komputerze Mac, łączyć się z większą liczbą narzędzi, tworzyć obrazy, uczyć się na podstawie Twoich poprzednich działań, zapamiętywać, jak pracujesz najlepiej, a także przejmować bieżące i cykliczne zadania. pic.twitter.com/UEEsYBDYfo

— OpenAI (@OpenAI) 16 kwietnia 2026 r

Nowa wersja może współdziałać z aplikacjami na komputerze użytkownika: wyświetlać ekran, klikać i pisać własnym kursorem. Na komputerach Mac wielu agentów może działać równolegle bez zakłócania pracy innego oprogramowania.

Wbudowana przeglądarka, wtyczki i cykl rozwoju

Codex ma wbudowaną przeglądarkę: strony można komentować bezpośrednio, co daje agentowi precyzyjne instrukcje. Jest to przydatne przy tworzeniu front-endu i gier.

Dzięki możliwości pracy na komputerze z systemem macOS, Codex może teraz korzystać z dowolnej aplikacji, widząc, klikając i wprowadzając tekst za pomocą własnego kursora.

Działa w tle, nie przejmując kontroli nad komputerem, wykonując zadania takie jak iteracje front-endu, testowanie aplikacji lub dowolne przepływy pracy bez dostępnego interfejsu API. pic.twitter.com/iO9iubLZX9

— OpenAI (@OpenAI) 16 kwietnia 2026 r

Twórcy planują rozszerzyć kontrolę przeglądarki poza środowisko lokalne.

Codex otrzymał również wsparcie dla gpt-image-1.5 do generowania i iteracji obrazów. Wraz ze zrzutami ekranu i kodem, pozwala to na tworzenie koncepcji wizualnych, projektów front-end, makiet i gier w jednym interfejsie.

Teraz możesz generować i iterować obrazy przy użyciu gpt-image-1.5 w Codex, tworząc projekty front-end, makiety, zasoby gier i inne, nie opuszczając swojego przepływu pracy.

Korzystanie jest zawarte w Twoim koncie ChatGPT, nie jest wymagany żaden klucz API. pic.twitter.com/ay17I3Nxoa

— OpenAI (@OpenAI) 16 kwietnia 2026 r

Firma OpenAI wydała ponad 90 dodatkowych wtyczek łączących umiejętności, integracje aplikacji i serwery MCP, w tym Atlassian Rovo dla JIRA, CircleCI, CodeRabbit, GitLab Issues, Microsoft Suite, Neon by Databricks, Remotion, Render i Superpowers.

W Codexie dodano obsługę komentarzy GitHub, wiele kart terminala i łączenie się ze zdalnymi środowiskami deweloperskimi za pomocą protokołu SSH (w wersji alfa).

Użytkownicy mogą otwierać pliki bezpośrednio na pasku bocznym, korzystając z ulepszonych funkcji przeglądania plików PDF, arkuszy kalkulacyjnych, slajdów i dokumentów, a także korzystać z nowego panelu podsumowania, aby śledzić plany agentów, źródła i artefakty.

Pamięć i planowanie

Codex nauczył się planować przyszłą pracę i automatycznie wznawiać zadania długoterminowe – potencjalnie oddalone o kilka dni lub tygodni. Zespoły korzystają z automatyzacji do wszystkiego, od próśb o przegląd kodu po śledzenie zadań w Slacku, Gmailu i Notion.

Źródło: OpenAI.

Twórcy ulepszyli pamięć asystenta. Codex nauczył się zapamiętywać użyteczny kontekst z poprzednich dialogów — osobiste preferencje i poprawki.

Model proaktywnie sugeruje również przydatne działania, kontynuując od miejsca, w którym użytkownik przerwał. Na przykład agent może znaleźć otwarte komentarze w Dokumentach Google, pobrać kontekst ze Slacka, Notion i bazy kodu, a następnie przedstawić listę priorytetowych działań.

Nowy model GPT

Ponadto OpenAI wprowadził model sztucznej inteligencji GPT-Rosalind, który ma przyspieszyć rozwój leków.

Poznaj GPT‑Rosalind, nasz zaawansowany model rozumowania opracowany z myślą o wspieraniu badań w dziedzinie biologii, odkrywania leków i medycyny translacyjnej. pic.twitter.com/PubLU0FkSv

— OpenAI (@OpenAI) 16 kwietnia 2026 r

Nazwa pochodzi od imienia angielskiej biofizyczki Rosalind Franklin, której badania pomogły odkryć strukturę DNA i położyły podwaliny współczesnej biologii molekularnej.

Twórcy zauważyli, że w USA opracowanie nowego leku zajmuje średnio 10–15 lat. Przyszłość leku w dużej mierze decyduje się na wczesnym etapie badań. Największe trudności wiążą się z analizą ogromnej liczby publikacji naukowych i wysoce wyspecjalizowanych baz danych.

Zadaniem GPT-Rosalind jest bycie asystentem biologa: streszczanie tekstów naukowych, formułowanie hipotez, projektowanie eksperymentów i przetwarzanie informacji. Model ten jest szczególnie skuteczny w zadaniach związanych z białkami, genami i podobnymi strukturami biologicznymi.

W teście BixBench (analiza bioinformatyczna w warunkach rzeczywistych) model GPT‑Rosalind uzyskał jeden z najlepszych wyników wśród modeli z opublikowanymi danymi.

W teście LABBench2 rozwiązanie przewyższyło GPT-5.4 w sześciu z 11 zadań. Największą lukę odnotowano w CloningQA, gdzie konieczne jest zaprojektowanie DNA i enzymów do protokołów klonowania molekularnego.

Dodatkowo, OpenAI udostępniło darmową wtyczkę Life Sciences do Codex na GitHubie. Jest ona dostępna dla wszystkich użytkowników i umożliwia połączenie sztucznej inteligencji z ponad 50 publicznymi naukowymi bazami danych i specjalistycznymi narzędziami.

Przypominamy, że 16 kwietnia Google wydało Gemini 3.1 Flash TTS, czyli udoskonalony model syntezy mowy oparty na generacji Gemini 3.