Google wprowadziło Gemma 4, nową rodzinę otwartych modeli sztucznej inteligencji przeznaczonych do zaawansowanego wnioskowania i przepływów pracy opartych na agentach.

Właśnie wydaliśmy Gemmę 4 — nasz jak dotąd najinteligentniejszy model open source.

Zbudowana na tej samej światowej klasy fundamencie badawczym co Gemini 3, Gemma 4 wprowadza przełomową inteligencję bezpośrednio do Twojego sprzętu, umożliwiając zaawansowane wnioskowanie i przepływy pracy oparte na agentach.

Wydano w celach komercyjnych… pic.twitter.com/W6Tvj9CuHW

— Google (@Google) 2 kwietnia 2026 r.

„Gemma 4 to nasz jak dotąd najinteligentniejszy otwarty model. Zapewniają one bezprecedensowy poziom inteligencji w przeliczeniu na każdy parametr” – czytamy w oświadczeniu.

Od premiery pierwszej generacji, deweloperzy pobrali Gemmę ponad 400 milionów razy, tworząc ponad 100 000 wariantów modeli w ekosystemie Gemmaverse. Najnowsza wersja opiera się na tych samych badaniach i technologii, co chatbot Gemini 3.

Różne rozmiary

Rodzina sieci neuronowych Gemma 4 obejmuje cztery wersje: Effective 2B (E2B), Effective 4B (E4B), 26B Mixture of Experts (MoE) i 31B Dense.

Kompaktowe modele E2B i E4B z 2,3 miliarda i 4,5 miliarda aktywnych parametrów koncentrują się na multimodalności, niskich opóźnieniach i płynnej integracji. Można je uruchomić na smartfonie lub zwykłym laptopie.

Modele MoE 26B i flagowy 31B (parametry 26 miliardów i 31 miliardów) wymagają akceleratora graficznego Nvidia H100 z 80 GB pamięci. Modele te są zoptymalizowane pod kątem badaczy i programistów.

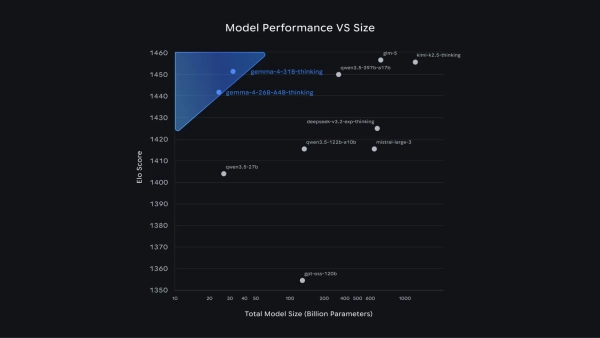

Starsze wersje osiągają wysokie wyniki w testach porównawczych. W światowym rankingu modeli z otwartym tekstem flagowy model Arena AI 31B zajmuje trzecie miejsce, a 26B – szóste. Według twórców, nowa linia przewyższa 20-krotnie większe odpowiedniki konkurencji.

Źródło: Google.

Główne cechy

Jedną z głównych zalet Gemmy 4 są jej zaawansowane możliwości rozumowania. Modele potrafią budować złożone układy logiczne i planować zadania w kilku etapach. Wykazują znaczny postęp w testach matematycznych i dokładnie wykonują polecenia.

Inne funkcje obejmują:

- przepływy pracy agentów — wbudowana obsługa wywołań funkcji, ustrukturyzowanego wyjścia JSON i instrukcji systemowych umożliwia tworzenie autonomicznych asystentów, którzy wchodzą w interakcje z narzędziami iinterfejsami API ;

- generowanie kodu — Gemma 4 obsługuje pisanie wysokiej jakości kodu w trybie offline, zmieniając stację roboczą w lokalnego asystenta AI;

- Wizja i dźwięk — wszystkie modele przetwarzają wideo i obrazy o zmiennej rozdzielczości, rozpoznają tekst i analizują diagramy. Modele E2B i E4B obsługują również rozpoznawanie i rozumienie mowy;

- rozszerzone okno kontekstowe – wersje kompaktowe obsługują 128 000 tokenów, a większe – do 256 000. To wystarcza do przetwarzania całych repozytoriów lub obszernych dokumentów w ramach jednego zapytania;

- wielojęzyczność — rodzina modelowa może pracować w ponad 140 językach.

Gemma 4 jest już dostępna w Google AI Studio i Google AI Edge Gallery. Integrację obsługują również popularne narzędzia i frameworki innych firm, takie jak Hugging Face, vLLM, llama.cpp, MLX, Ollama, NVIDIA NIM i LM Studio.

Modele można konfigurować za pośrednictwem Google Colab, Vertex AI lub na lokalnych kartach graficznych. Do wdrożenia produkcyjnego dostępne jest Google Cloud, w tym Cloud Run, GKE i Sovereign Cloud.

Przypomnijmy, że na początku kwietnia Google zaprezentowało nowy model sztucznej inteligencji do generowania wideo — Veo 3.1 Lite.