OpenAI zintegrowało model GPT-5.3 Instant z ChatGPT, dostosowując ton, trafność i płynność dialogu. Dzięki temu codzienne rozmowy z chatbotem staną się bardziej użyteczne i naturalne, twierdzą twórcy.

Dla porównania, model GPT-5.2 Instant czasami udzielał „przesadnie ostrożnych i pouczających” odpowiedzi na drażliwe tematy. Zaktualizowany model jest znacznie mniej skłonny do moralizatorstwa.

Podczas pracy z danymi z internetu, odpowiedzi GPT-5.3 Instant stały się bardziej znaczące i ustrukturyzowane. Lepiej rozpoznaje podtekst zapytania i porównuje uzyskane informacje z własną wiedzą i logiką.

Ogólnie rzecz biorąc, styl komunikacji nowego modelu stał się bardziej naturalny, a zbędne zwroty typu „Stop. Weź oddech” zniknęły. Narzędzie rzadziej „halucynuje” i lepiej radzi sobie z pisaniem tekstów. Jednak w niektórych językach odpowiedzi mogą brzmieć zbyt dosłowne, ostrzega OpenAI.

GPT-5.3 Instant jest już dostępny dla wszystkich użytkowników ChatGPT oraz programistów za pośrednictwem API . Wsparcie dla GPT-5.2 Instant będzie kontynuowane do 3 czerwca 2026 r.

Analog GitHub

Według doniesień medialnych, OpenAI pracuje nad odpowiednikiem na GitHubie. Projekt jest na wczesnym etapie, ale podjęto już strategiczną decyzję.

Oczekuje się, że usługa będzie dostępna za opłatą, ale dziennikarze nie podają więcej szczegółów.

Prawdopodobnym powodem stworzenia produktu były regularne przerwy w działaniu serwisu GitHub, które sprawiały problemy inżynierom OpenAI.

Jeśli firma uruchomi własną platformę do przechowywania kodu, stanie się bezpośrednim konkurentem dla swojego głównego udziałowca, Microsoftu (właściciela GitHub).

Pod koniec lutego OpenAI pozyskało 110 miliardów dolarów inwestycji przy wycenie 730 miliardów dolarów. Runda finansowania stała się jedną z największych w historii startupów.

Zaktualizowano Gemini

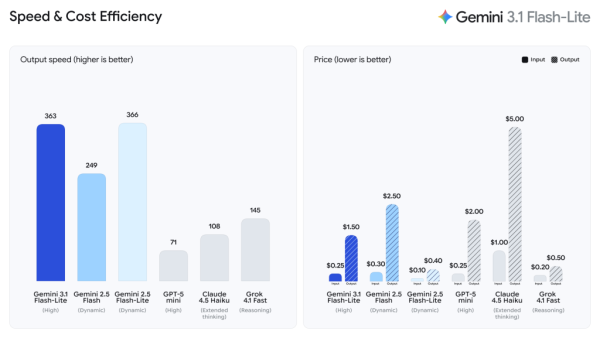

Z kolei Google wypuściło wersję zapoznawczą Gemini 3.1 Flash-Lite — „najbardziej ekonomicznego i najszybszego” modelu rodziny Gemini 3.

Koszt korzystania z sieci neuronowej wynosi 0,25 USD za milion tokenów przychodzących i 1,5 USD za milion tokenów wychodzących.

Model jest zoptymalizowany pod kątem tworzenia agentów AI i skalowania: może obsługiwać tłumaczenie dużych ilości danych, moderowanie treści i generowanie interfejsów użytkownika.

Według niezależnych badaczy z Artificial Analysis, nowy produkt przetwarza informacje 2,5 razy szybciej niż Gemini Flash 2.5.

Źródło: Google.

Wersja Flash-Lite 3.1 jest dostępna w wersji zapoznawczej dla programistów za pośrednictwem interfejsu API Gemini oraz w Google AI Studio, a dla firm w Vertex AI.

Przypomnijmy, że w lutym Google zaprezentowało Gemini 3.1 Pro — udoskonalony model sztucznej inteligencji, który pobił rekordy w testach porównawczych.

Google zaktualizował już tryb rozumowania Deep Think w Gemini 3. Narzędzie to jest pozycjonowane jako rozwiązanie złożonych problemów naukowych i inżynieryjnych.