Jeszcze niedawno branża półprzewodników leczyła rany po recesji, którą wywołała pandemia. Składy były przepełnione, a ceny nurkowały w dół. Obecnie sytuacja odwróciła się o 180 stopni, a rozpędzony na dobre szał na AI znalazł kolejny cel. Tym razem wybór padł na moduły RAM, których wartość gwałtownie poszybowała w górę, a za nią zyski i wyceny potentatów. Dla użytkownika oznacza to jedno: droższe komputery, lecz dla inwestorów: raj na ziemi.

Czy czołowa trójka dźwiga rewolucję?

Podobnie jak w przypadku chipów, mamy do czynienia ze ścisłym kręgiem producentów, tak samo w segmencie pamięci operacyjnej w centrum tego zjawiska znajdują się trzej liderzy, kontrolujący niemal 100% globalnej produkcji pamięci. To koreańskie firmy SK Hynix i Samsung oraz amerykański Micron.

Z jakiego powodu właśnie pamięć i jej wytwórcy nagle zyskali na znaczeniu? Jak nie wiadomo, o co chodzi, to chodzi o finanse, a w świecie cyfrowym walutą nie są dolary czy euro, lecz przepustowość. Nowoczesne LLM-y to cyfrowe kolosy o wadze dziesiątek gigabajtów, które muszą być momentalnie przesyłane do jednostek obliczeniowych. Ostatecznie, gdy pytamy czat o przepis na wypieki, żądamy analizy arkusza kalkulacyjnego w pracy lub (co szczególnie prądożerne) generujemy kolejny infantylny obrazek, oczekujemy wyników natychmiast, a to kosztuje…

Pamięci nowej generacji, takie jak DDR5 czy szczególnie kluczowa w tej materii wyspecjalizowana pamięć HBM (o której za chwilę), przestały być tylko biernym „magazynem”, a stały się wielotorową autostradą. Bez niej silniki AI zwyczajnie dusiłyby się własną potęgą.

HBM, czyli nowy “święty gral”?

Czym zatem jest ów „święty gral” o nazwie HBM? Aby pojąć różnicę, musimy przyjrzeć się, jak przemieszczają się dane. Klasyczna pamięć RAM (obecnie w najnowszej wersji DDR5) w Twoim komputerze to bardzo szybki posłaniec na skuterze. Przemierza drogę prędko, lecz może unieść ze sobą tylko małą pakę naraz. To doskonałe rozwiązanie do gier (gdyby ceny nie poszły w górę) i systemu Windows.

Jednak AI potrzebuje czegoś odmiennego. Pamięć HBM (High Bandwidth Memory) to potężny skład towarowy. Może nie gna tak szybko jak skuter, ale holuje za sobą tysiące wagonów jednocześnie. Dodatkowo, kontenery, które transportuje, są wielopiętrowe – dzięki technologii wertykalnego układania kości (3D Stacking), inżynierowie stworzyli pamięć o niespotykanie szerokiej „bramie” transmisyjnej. Zamiast pojedynczej wąskiej drogi, mamy tutaj wielotorową magistralę. Rezultat? Podczas gdy topowe DDR5 przesyła informacje z szybkością ok. 100 GB/s, najświeższe układy HBM3e osiągają oszałamiające 1200 GB/s na jeden stos. Właśnie ta ogromna przepustowość pozwala „zasilać” nienasycone procesory AI.

Kto bije tę monetę?

Skoro przepustowość to pieniądz, to mennicą XXI wieku stały się fabryki w Korei i USA. To one decydują o tym, jak dynamicznie rozwija się AI, a rynek wycenia tę moc na miliardy dolarów. Niewątpliwym liderem tego wyścigu stał się południowokoreański SK Hynix. Przedsiębiorstwo, które przez lata funkcjonowało nieco w cieniu Samsunga, dostarczając pamięci do naszych komputerów przenośnych i smartfonów (możecie je kojarzyć np. z modułów RAM od G.Skill czy Kingston), postawiło wszystko na jedną kartę – wspomniane pamięci HBM (High Bandwidth Memory) i co kluczowe w momencie, gdy konkurencja spała.

To się opłaciło. Dziś, dzięki kooperacji z Nvidią, to właśnie układy Hynixa napędzają najpotężniejsze akceleratory AI na świecie.

W minionym kwartale zysk operacyjny firmy wzrósł o niebywałe 137% rdr, a inwestorzy, widząc w Hynixie głównego beneficjenta wzrostu, podnieśli cenę akcji o przeszło 200% w zaledwie pół roku i aż 330 procent w skali całego roku.

TradingView

Amerykanie też wyczuwają zyski

Tuż za nim podążają Amerykanie z Micron Technology. Ich rezultaty to dowód na zmianę warty w branży. Jeszcze niedawno sytuacja finansowa firmy zależała od niestabilnego rynku smartfonów, ale najnowsze raporty (za IV kwartał fiskalny) nie pozostawiają wątpliwości: przychody poszybowały o 93% rok do roku (do 7,75 mld USD), wyciągając firmę z dołka finansowego.

Kluczowa liczba to jednak przychody z samego segmentu serwerowego, które wzrosły o gigantyczne 152%, eliminując rynek konsumencki. Ponadto, zarząd poinformował, że ich zdolności produkcyjne dla najdroższych układów HBM są już w całości wyprzedane.

Giełda odnotowała te nowiny natychmiast – akcje wystrzeliły w górę, a dzisiaj Micron wyceniany jest niemal 390 procent wyżej niż przed rokiem.

TradingView

Samsung się odrodził i gra przeciwko sobie?

W tym układzie jest jeszcze trzeci uczestnik – Samsung, który choć z początku pozostał w tyle za SK Hynix w konkurencji, aktualnie nadrabia straty skalą i wolumenem produkcji. Zysk operacyjny ich działu chipów (DS Division) w ostatnim kwartale wzrósł niemal trzykrotnie kwartał do kwartału, wyciągając dywizję z miliardowych strat odnotowywanych jeszcze rok wcześniej. W najnowszym raporcie firma pochwaliła się zyskiem na poziomie 6,45 biliona wonów (ok. 4,7 mld USD).

Wycena w perspektywie roku wzrosła z kolei o ponad 200 procent.

TradingView

Taniej już było, a będzie tylko drożej. I znowu odczują to gracze

Jeśli jesteście graczami i spodziewaliście się, że obecne zwyżki to jedynie chwilowa zadyszka rynku, to tak się nie stanie. W analizach największych banków inwestycyjnych, jak donosi agencja Bloomberga, coraz częściej pada pojęcie „Memory Supercycle”. To sporadyczne zjawisko, w którym popyt strukturalnie przewyższa podaż nie przez kwartał, a przez całe lata.

Skąd więc ten pesymizm dla kieszeni konsumentów? Tu wracamy do brutalnej fizyki produkcji. Wytwarzanie zaawansowanej pamięci HBM jest znacznie bardziej złożone i „powierzchniożerne” niż w przypadku standardowego RAM-u. Branżowa "złota zasada" mówi, że moce przerobowe wafla krzemowego potrzebne do stworzenia 1 GB pamięci HBM, „konsumują” możliwość wyprodukowania aż 3 GB tradycyjnego DDR5. Producenci mają zatem prosty wybór: albo produkować masowo tanią pamięć do komputerów, albo przestawić linie na superdrogą pamięć dla Nvidii. Decyzja, patrząc na marże, jest oczywista.

Widać to zresztą już w poczynaniach firm i prowadzi do sytuacji wręcz absurdalnych. Najlepszym przykładem jest tu Samsung, gdzie dział produkcji pamięci zaczął odmawiać priorytetowego kontraktowania kości do smartfonów produkowanych przez… dział mobilny Samsunga.

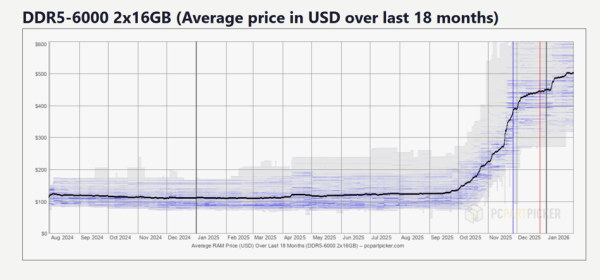

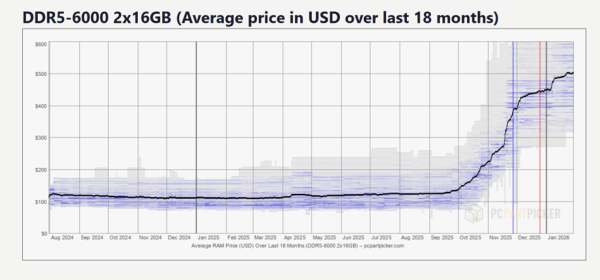

Eksperci z TrendForce nie pozostawiają nadziei – czeka nas następna fala podwyżek. Prognozy na pierwszą połowę 2026 roku wskazują na skoki cen kontraktowych DDR5 nawet o 30-60%, mimo że dotychczasowe zwyżki i tak są już drastyczne.

pcpartpicker.com

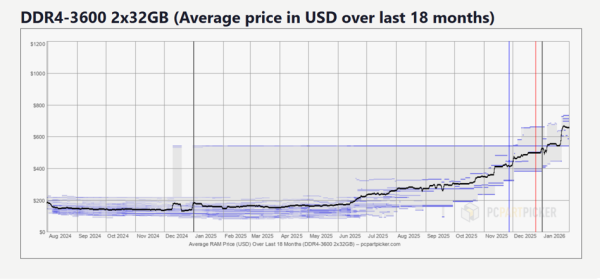

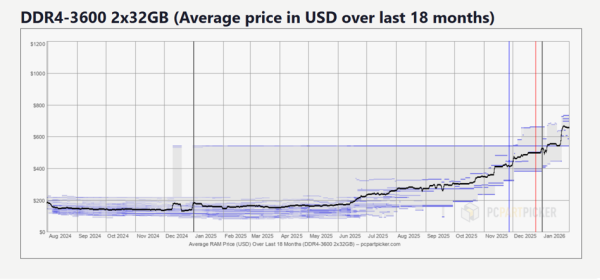

Co gorsza, oberwie się też starszemu standardowi DDR4, lecz zamiast tanieć z powodu wymiany pokoleniowej, również drożeje, ponieważ jest tańszy w zakupie i nadal dostępny, ale… nikt już nie chce go produkować. Mechanizmy rynkowe widać tutaj jak na dłoni.

pcpartpicker.com

Jaki płynie z tego morał dla statystycznego obywatela? Żyjemy w czasach, w których "informacje to nowe bogactwo", a pamięć RAM stała się tankowcem do ich transferu. Dopóki potentaci tacy jak Google, Microsoft czy OpenAI będą prowadzić wyścig zbrojeń, wpompowując miliardy w infrastrukturę, dopóty my, konsumenci, będziemy opłacać swoisty "podatek od AI" przy zakupie każdego komputera i komponentu.

Producenci pamięci po trudnych latach wreszcie trafili na swój złoty interes i nie zamierzają prędko redukować dostaw dla rynku konsumenckiego. Tym bardziej, że giganci nie planują zwalniać z tempem inwestycji. Chociażby tylko Meta w najnowszym sprawozdaniu finansowym Meta zadeklarowała, że w samym 2026 roku firma planuje przeznaczyć na infrastrukturę AI gigantyczną kwotę, między 115 a 135 miliardów dolarów. To prawie podwojenie wydatków z wcześniejszego roku.